На фоне стремительного развития технологий искусственного интеллекта и расширения сети центров обработки данных модернизация систем охлаждения становится все более актуальной задачей. Рост удельной мощности стоек объективно требует внедрения более прогрессивных решений для обеспечения бесперебойности и надежности ИТ-инфраструктуры. На одном из отраслевых вебинаров эксперты компании Dantex и интегратора Telinter подробно разобрали, что происходит с рынком ЦОД прямо сейчас, а технический специалист Юрий Чуриков, объяснил, почему воздушное охлаждение уходит в прошлое, а жидкостное охлаждение становится все более популярным.

На фоне стремительного развития технологий искусственного интеллекта и расширения сети центров обработки данных модернизация систем охлаждения становится все более актуальной задачей. Рост удельной мощности стоек объективно требует внедрения более прогрессивных решений для обеспечения бесперебойности и надежности ИТ-инфраструктуры. На одном из отраслевых вебинаров эксперты компании Dantex и интегратора Telinter подробно разобрали, что происходит с рынком ЦОД прямо сейчас, а технический специалист Юрий Чуриков, объяснил, почему воздушное охлаждение уходит в прошлое, а жидкостное охлаждение становится все более популярным.

Почему об охлаждении заговорили именно сейчас?

Вырос сам рынок вычислений. Юрий привел следующие данные. Мировой спрос на продукты питания увеличивается приблизительно на 1,5% в год, что сопоставимо с темпами роста населения. В то же время ежегодный рост спроса на вычислительные мощности и хранение данных превышает 30%.

При этом сами центры обработки данных различаются по своему назначению. Эксперт выделил четыре основных типа.

Первый тип представлен классическими коммерческими ЦОД, или colocation центрами, где клиенты арендуют стойки и вычислительные мощности. Второй тип составляют AI центры, специально спроектированные для обучения нейросетей и отличающиеся высокой плотностью размещения графических и тензорных процессоров. Третий тип включают гиперскейлеры, т. е. крупные промышленные объекты мощностью от одного гигаватта каждый. Четвертый тип формируют частные ЦОД, принадлежащие отдельным организациям, таким как банки, налоговые службы или крупные онлайн сервисы.

Для каждого из перечисленных типов требуется своя стратегия охлаждения, но общим вектором остается повышение плотности тепловыделения.

Одна стойка вместо 900

Одним из наиболее заметных индикаторов происходящих изменений выступает эволюция аппаратной платформы. По словам спикера, глава компании NVIDIA Джейсон Хванг в ходе презентации в феврале текущего года предложил новое определение понятия «дата центр». Согласно его версии, прежний подход, при котором ЦОД предоставлял услуги, уходит в прошлое. Новый рассматривает ЦОД как производственную единицу по генерации токенов. Токены представляют собой фрагменты данных, включая пиксели, сегменты кода, буквы или закодированные части звука.

Ключевой тезис, который продемонстрировал Хванг, заключается в том, что новые процессоры генерируют токены в несколько раз быстрее по сравнению с предыдущими поколениями. Более значимым фактором является соотношение производительности. Одна стойка Rubin, которую NVIDIA представляет в текущем году, заменяет по вычислительной мощности 900 стоек с процессорами A100. Объем в 900 стоек соответствует среднему или даже более крупному российскому ЦОД. Такие стойки уже заказаны и будут поставлены в центры обработки данных международных компаний в текущем году в значительных объемах.

Если одна стойка обеспечивает вычислительную мощность, ранее доступную лишь для целого зала, то уровень выделяемого тепла возрастает пропорционально. Согласно данным компаний Schneider Electric и Vertiv, уже в 2026 г. мощность стоек в AI центрах превысит 600 киловатт, а в ближайшие годы достигнет одного мегаватта на стойку.

Повышение рабочей температуры

Производители ИT-оборудования одновременно с ростом энергопотребления поднимают допустимую рабочую температуру охлаждающей жидкости. В рамках проводимых на данный момент тестов были сделаны выводы о том, что на данный момент рабочая температура охлаждающей жидкости может составлять до 45 градусов. Чем теплее теплоноситель, тем меньше энергии требуется на его охлаждение. И тем больше времени в году система может работать в режиме фрикулинга, т. е. охлаждаться за счет наружного воздуха без запуска компрессоров.

Таким образом, рост тепловыделения отчасти компенсируется повышением допустимых температур. В данном случае задача инженера состоит в том, чтобы правильно этим воспользоваться.

Российская специфика

На глобальном рынке сейчас популярны сборные конструкции. Для простоты понимания, это можно сравнить с конструктором LEGO. Заказчик заранее получает модули, привозит их на площадку и собирает ЦОД, постепенно наращивая мощность до гигаватта и выше.

В России, как отметил Юрий, такой путь ограничен. На данный момент в связи с санкциями доступ к иностранному кредитованию отсутствует, а внутреннее достаточно дорогое, санкции также перекрыли поставки многих современных компонентов. Вдобавок к этому существует неопределенность со спросом, и коммерческие операторы колокейшн-центров не знают, сколько клиентов захотят арендовать стойки под ИИ. Их может быть десять, а может не быть ни одного. Поэтому строить сразу гигаваттный ЦОД «на вырост» никто не рискует.

Отсюда спрос на гибкие, масштабируемые системы охлаждения, которые можно наращивать поэтапно, они не требуют гигантских единовременных вложений.

Эволюция охлаждения

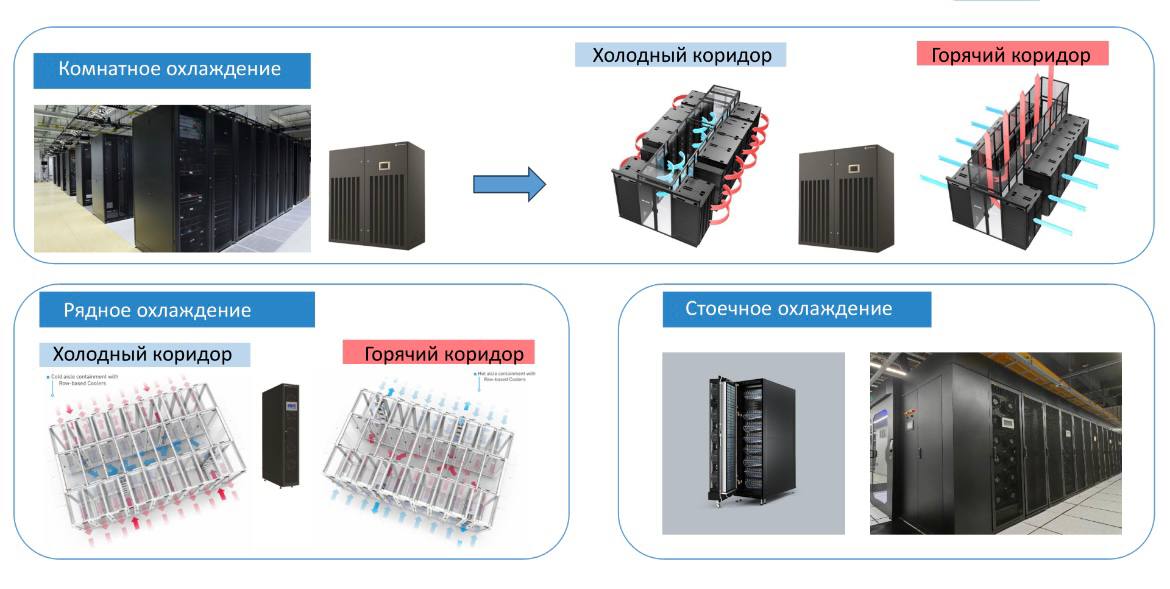

В рамках вебинара спикер представил краткий обзор эволюции систем охлаждения ЦОД. На начальном этапе в серверных помещениях использовались прецизионные кондиционеры, подававшие холодный воздух в неорганизованном режиме, что приводило к смешиванию воздушных масс, снижению эффективности теплообмена и как следствие нестабильности температурного режима.

В рамках вебинара спикер представил краткий обзор эволюции систем охлаждения ЦОД. На начальном этапе в серверных помещениях использовались прецизионные кондиционеры, подававшие холодный воздух в неорганизованном режиме, что приводило к смешиванию воздушных масс, снижению эффективности теплообмена и как следствие нестабильности температурного режима.

С развитием технологий стало понятно, что смешивание холодного и горячего воздуха неэффективно, это обусловило внедрение схемы с разделением на «горячие» и «холодные» коридоры. Данное решение позволило существенно повысить эффективность охлаждения. Однако для современных высокоплотных нагрузок такая конфигурация уже не является достаточной.

Следующим этапом стало внедрение рядного охлаждения, когда кондиционеры размещаются между стойками, в непосредственной близости от серверного оборудования. Эффективность такой схемы выше по сравнению с настенными решениями. Однако ее уже не хватает для обеспечения отвода тепла при нагрузках 20–30 кВт на стойку.

Следом идет «холодная стена». Данное решение является не отдельным кондиционером, а полноценной системой, включающей фреоновый контур и жидкостное охлаждение конденсатора. Это позволяет отводить десятки киловатт тепла с одной стойки.

Наиболее технологичный вариант – прямое жидкостное охлаждение серверов, при котором теплоноситель подается непосредственно к процессорам. Для таких систем компании предлагают чиллеры на магнитных подшипниках, драйкулеры с системой адиабатического предохлаждения (орошаемые маты, повышающие эффективность охлаждения в условиях высоких наружных температур), гидромодули и CDU. Температурный график 34/44°С и выше позволяет обеспечивать круглогодичную работу в режиме фрикулинга при большинстве погодных условий, характерных для средней полосы.

Проекты в России

Спикер привел несколько примеров внедрения оборудования от компании Dantex на разных объектах.

Один из крупнейших коммерческих ЦОД Москвы, Campus Moscow South, уже ввел четыре фазы. Его ИТ мощность достигает 33 МВт при 3 942 стойко местах, сейчас строится пятая фаза на 8 МВт. Инженеры применили там воздушное охлаждение до 55 кВт на стойку и организовали лабораторию с водовоздушным охлаждением для суперкомпьютеров на 60–100 кВт, а также внедрили систему «холодная стена» (LSV). Температурный график поддерживается в диапазоне 18–28 °С с дельтой 10 °С, что позволяет три четверти времени работать в режиме фрикулинга. В итоге среднегодовой коэффициент энергоэффективности ЦОД при полной нагрузке держится ниже 1,3, что в общемировой практике считается отличным результатом.

Еще один заметный коммерческий проект – IXcellerate MOS 5, где применили изолированные «горячие коридоры» и ту же технологию LSV. Холодоснабжение закольцовано, а чиллеры с фрикулингом мощностью от 350 до 1650 кВт работают на инверторном управлении с адиабатическим предохлаждением. Все компоненты зарезервированы по схеме N+2. Микроклимат поддерживается по стандарту ASHRAE TC 9.9 с параметрами 22–26 °С и влажностью 40–60%. В одном из залов установили 128 стоек по 44 кВт и еще 60 по 12 кВт, что дает ИТ мощность зала 6,3 МВт.

Среди других проектов можно выделить Wildberries и финский объект «Яндекса». Там используются стоечные решения с рабочим диапазоном от +18 до +40 °С и серверами без внутренних вентиляторов.

Критерии выбора

На рынке существует множество формальных критериев оценки эффективности систем охлаждения, таких как PUE, COP, EER, результаты CFD моделирования и уровни надежности TIER. Однако с практической точки зрения выбор решения определяется исключительно плотностью нагрузки на стойку.

Если нагрузка не превышает 8 кВт на стойку, достаточно классического воздушного охлаждения с организацией холодного коридора при температуре воздуха 25 °С.

При увеличении плотности от 20 кВт на стойку становится целесообразным комбинированное охлаждение, совмещающее воздушный и жидкостный контуры.

Когда нагрузка достигает 30 кВт на стойку, требуется прямое водяное охлаждение серверов. При этом температурный график теплоносителя должен составлять от 34/44 °С и выше, обеспечивая круглогодичную работу системы в режиме фрикулинга.

Для нагрузок в диапазоне 60–100 кВт на стойку единственным эффективным решением становится жидкостное охлаждение, реализуемое на базе промышленных чиллеров и драйкулеров.

Спикер подчеркнул, что не следует внедрять избыточно сложные схемы охлаждения, если текущий уровень нагрузок этого не требует. Более рациональный подход заключается в закладывании возможности масштабирования и поэтапного перехода от воздушного охлаждения к жидкостному по мере роста плотности мощности на стойку.

Артем Пермяков, Connect